Spark入门(七)Spark SQL thriftserver/beeline启动方式

发布日期:2021-07-01 01:15:36

浏览次数:2

分类:技术文章

本文共 1051 字,大约阅读时间需要 3 分钟。

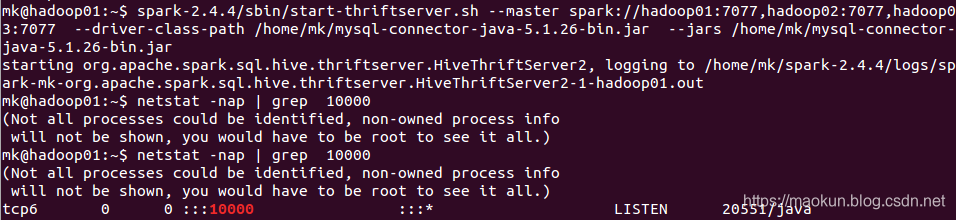

一、启动thrift服务

启动thriftServer,默认端口为10000,。

--jars 添加worker类库

--driver-class-path 驱动类库

--master spark集群地址

--total-executor-cores 启动的核数,默认是所有核数

--executor-memory 每个work分配的内存,默认是work的所有内存

--hiveconf hive.server2.thrift.port 启动端口

spark-2.4.4/sbin/start-thriftserver.sh --master spark://hadoop01:7077,hadoop02:7077,hadoop03:7077 --driver-class-path /home/mk/mysql-connector-java-5.1.26-bin.jar --jars /home/mk/mysql-connector-java-5.1.26-bin.jar --total-executor-cores 2 --executor-memory 1gnetstat -nap | grep 10000

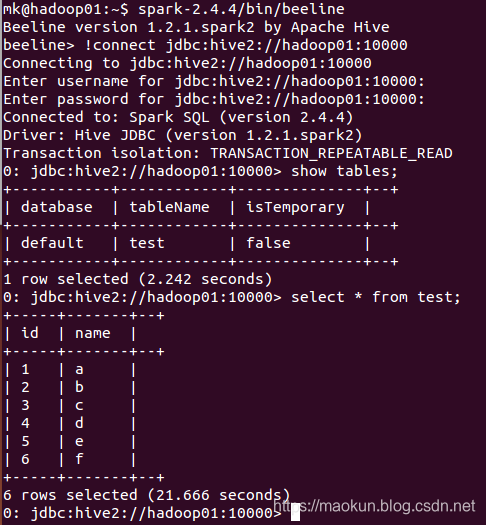

二、启动beeline

spark-2.4.4/bin/beeline#连接!connect jdbc:hive2://hadoop01:10000show tables;select * from test;#退出!quit

三、总结

thriftserver/beeline和普通的spark-shell/spark-sql区别

(1)对于derby存储元数据

1、spark-shell、spark-sql是启动一个spark application,只能服务于唯一的客户端,同一路径启动多客户端会报错; 2、thriftservers是启动一个spark application提供接口服务,为多客户端进行服务。解决了数据共享的问题,多个客户端可以共享数据问题;(2)对于其他非本地的数据库存储元数据

1、spark-shell、spark-sql是启动一个spark application,服务于一个的客户端。可以启动多个spark-shell、spark-sql,客户端之间的操作互相不干扰。

2、thriftservers是启动一个spark application提供接口服务,为多客户端进行服务。如有客户端的操作过多,会干扰到其他客户端的进一步操作。转载地址:https://maokun.blog.csdn.net/article/details/104128223 如侵犯您的版权,请留言回复原文章的地址,我们会给您删除此文章,给您带来不便请您谅解!

发表评论

最新留言

哈哈,博客排版真的漂亮呢~

[***.90.31.176]2024年04月16日 08时17分11秒

关于作者

喝酒易醉,品茶养心,人生如梦,品茶悟道,何以解忧?唯有杜康!

-- 愿君每日到此一游!

推荐文章

select下拉框分组展示插件的使用--(select-mania插件的使用)

2019-04-30

Java Lambda表达式的应用--Stream API操作集合框架

2019-04-30

Myslq连接(JDBC)url属性的参数的设置

2019-04-30

关于Spring MVC与前端的交互

2019-04-30

大厂经典面试题:Redis为什么这么快?

2019-04-30

Android之Retrofit基本用法篇

2019-04-30

Netty与网络协议资料整理

2019-04-30

golang实现大数据量文件的排序

2019-04-30

golang中的time包

2019-04-30

2019NOIP D4题 加工领奖

2019-04-30

2021.5.19 JS高级第二天

2019-04-30

SpringBoot内置Tomcat配置参数

2019-04-30

linux 根目录下文件夹分析

2019-04-30

linux 查看分区和文件大小

2019-04-30

Not using PCAP_FRAMES 解释(snort中)

2019-04-30

技术转管理?这些“坑”你要绕道走

2019-04-30

领域驱动设计(DDD)前夜:面向对象思想

2019-04-30

Camera驱动调试小记

2019-04-30

四线触摸屏原理

2019-04-30